La recherche de Deloitte indique que seulement 23 % des organisations se sentent pleinement préparées à gérer les risques liés à l'IA, ce qui laisse des lacunes importantes en matière de surveillance et de sécurité.

- Qu'est-ce que la gouvernance de l'IA ?

- Cadres de gouvernance de l'IA

- Lignes directrices en matière d'éthique et de responsabilité

- Cadres réglementaires

- Transparence et explicabilité

- Suivi et amélioration continue

- MetaDefender Managed File Transfer MFT) – Solution de sécurité et de conformité basée sur l'IA

- FAQ sur la gouvernance de la sécurité de l'IA

Qu'est-ce que la gouvernance de l'IA ?

La gouvernance de l'IA est le système de politiques, de cadres et de surveillance qui régit la manière dont l'intelligence artificielle est développée, utilisée et réglementée. Elle garantit que l'IA fonctionne dans la transparence, la responsabilité et la sécurité au sein des organisations, des industries et des gouvernements.

La protection des systèmes d'IA afin qu'ils puissent fonctionner en toute sécurité, de manière éthique et dans le respect des réglementations est devenue une priorité absolue. Sans une gouvernance appropriée, les systèmes d'IA peuvent introduire des biais, violer les exigences réglementaires ou devenir des risques pour la sécurité.

Par exemple, un outil de recrutement par IA formé sur des données d'embauche historiques peut, par inadvertance, donner la priorité à certains groupes démographiques plutôt qu'à d'autres, renforçant ainsi les schémas discriminatoires. Dans des secteurs comme la santé ou la finance, le déploiement de l'IA sans respecter les lois régionales sur la protection des données peut entraîner des violations de la réglementation et des amendes substantielles.

En outre, les modèles d'IA intégrés dans les services publics sans contrôles adéquats de prévention des menaces peuvent être exploités par des tentatives d'exploitation malveillantes, exposant ainsi les organisations à des cyberattaques et à des perturbations opérationnelles.

Principes clés de la gouvernance de l'IA

Une stratégie de gouvernance de l'IA bien définie intègre des principes essentiels qui aident les organisations à garder le contrôle sur les prises de décision basées sur l'IA. Selon une enquête de l'Institut Ponemon, 54 % des personnes interrogées ont adopté l'IA, tandis que 47 % des équipes de sécurité ont fait part de leurs inquiétudes quant aux vulnérabilités introduites par le code généré par l'IA.

Les principes fondamentaux suivants sont essentiels à une gouvernance efficace de l'IA et contribuent à atténuer les risques opérationnels et de sécurité :

Les protocoles de sécurité protègent les modèles d'IA contre les attaques adverses, les modifications non autorisées et les cybermenaces émergentes.

L'obligation de rendre des comptes garantit que les systèmes d'IA font l'objet d'une surveillance désignée, ce qui empêche toute prise de décision non réglementée et renforce le contrôle humain.

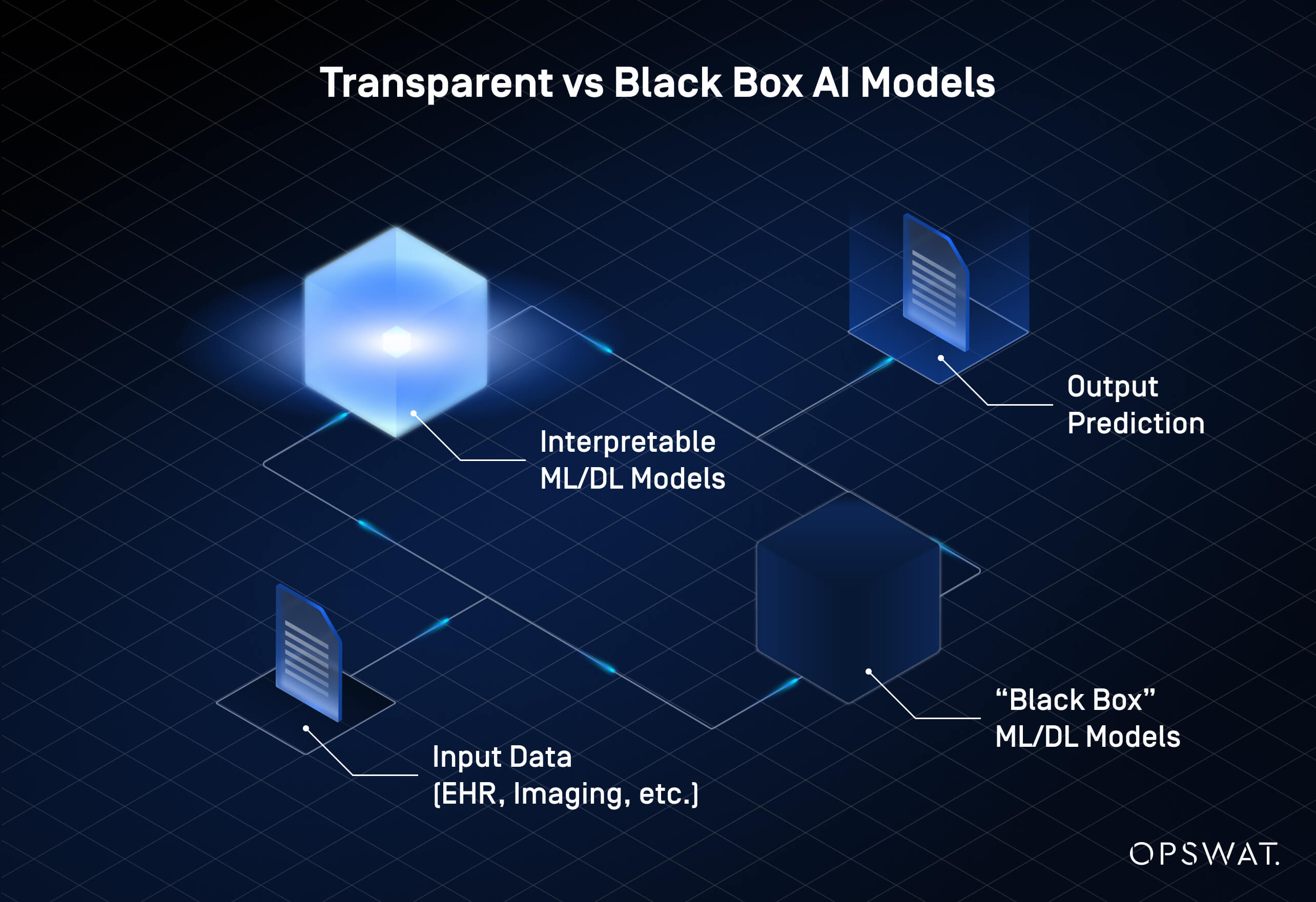

La transparence exige que les modèles d'IA fournissent des informations claires sur leurs processus de prise de décision, réduisant ainsi les risques liés aux modèles à boîte noire qui manquent d'interprétabilité.

En intégrant ces principes dans les cadres de gouvernance, les organisations peuvent atténuer les risques tout en maintenant l'efficacité et l'évolutivité des technologies de l'IA.

Le besoin croissant de gestion des risques liés à l'IA

L'adoption rapide de l'IA a introduit de nouveaux défis en matière de gestion des risques et de conformité. Sans stratégies adaptatives, les organisations risquent de prendre du retard face aux menaces émergentes et aux pressions réglementaires.

La gestion des risques liés à l'IA se concentre sur

- L'alignement des stratégies de gouvernance sur l'évolution des réglementations et des mandats de surveillance de l'IA spécifiques à l'industrie garantit que les organisations respectent les exigences légales.

- La détection permanente des préjugés et les audits d'équité sont nécessaires pour prévenir les schémas discriminatoires dans la prise de décision de l'IA.

- Les attaques de phishing améliorées par l'IA, la fraude deepfake et la manipulation de modèles sont des préoccupations croissantes, nécessitant des mesures de sécurité proactives.

Pour garder une longueur d'avance sur ces risques, les organisations doivent intégrer la gouvernance de l'IA dans des cadres plus larges de gestion des risques, en veillant à ce que les considérations de conformité, de sécurité et d'éthique restent intégrées au développement et au déploiement de l'IA.

Cadres de gouvernance de l'IA

Un cadre structuré de gouvernance de l'IA aide les organisations à naviguer dans les exigences de conformité, à gérer les risques et à intégrer des mesures de sécurité dans les systèmes d'IA. L'intégration d'un modèle de gouvernance de la sécurité clair dans les cadres de gestion des risques liés à l'IA réduit la fragmentation des initiatives en matière d'IA et renforce la couverture de la conformité.

Développement du cadre

L'élaboration d'un cadre de gouvernance de l'IA nécessite une approche stratégique qui s'aligne sur les politiques de l'organisation et les normes réglementaires. Les éléments suivants représentent les composantes essentielles d'un processus efficace d'élaboration d'un cadre :

Évaluation des risques

Identifier les vulnérabilités des modèles d'IA, y compris les biais, les problèmes de confidentialité et les menaces pour la sécurité.

Intégration réglementaire

Veiller à ce que la gouvernance de l'IA soit conforme aux exigences spécifiques du secteur et aux normes mondiales.

Collaboration interfonctionnelle

Créer un cadre de gouvernance qui réponde à la fois aux préoccupations éthiques et aux besoins opérationnels.

Intégration dans les politiques organisationnelles existantes

La gouvernance de l'IA ne devrait pas fonctionner de manière isolée, mais plutôt s'aligner sur les politiques plus larges de l'entreprise en matière de cybersécurité, d'éthique et de gestion des risques. L'intégration des politiques d'IA dans la gestion des risques de l'entreprise garantit que les modèles d'IA respectent les protocoles de sécurité et les directives éthiques.

Les mécanismes d'audit de l'IA peuvent aider à détecter rapidement les défaillances de gouvernance, tandis que le suivi de la conformité permet aux organisations de garder une longueur d'avance sur l'évolution des réglementations. Les partenariats externes avec des fournisseurs d'IA et des prestataires de sécurité peuvent également améliorer les stratégies de gouvernance, en réduisant les risques associés aux solutions d'IA tierces.

Stratégies de mise en œuvre

Une gouvernance réussie de l'IA nécessite une approche de mise en œuvre structurée, tirant parti à la fois de la technologie et des stratégies axées sur les politiques. De nombreuses organisations se tournent vers des outils de conformité alimentés par l'IA pour automatiser les processus de gouvernance et détecter les violations réglementaires en temps réel. Les principales mesures de mise en œuvre comprennent :

- Les solutions de conformité axées sur la technologie utilisent l'IA pour suivre l'adhésion aux politiques, surveiller les facteurs de risque et automatiser les procédures d'audit.

- Les stratégies de gestion du changement garantissent l'adoption des politiques de gouvernance de l'IA dans l'ensemble de l'organisation.

- La planification de la réponse aux incidents traite des risques de sécurité spécifiques à l'IA, en veillant à ce que les organisations disposent de mesures proactives pour gérer les défaillances de gouvernance, les cyberattaques et les violations de l'éthique.

En intégrant des cadres de gouvernance dans les politiques existantes et en adoptant des stratégies de mise en œuvre structurées, les organisations peuvent s'assurer que les systèmes d'IA restent sûrs, éthiques et conformes.

Lignes directrices en matière d'éthique et de responsabilité

Alors que les systèmes d'IA influencent les décisions à fort enjeu, les organisations doivent établir des lignes directrices éthiques et des structures de responsabilité pour garantir une utilisation responsable. Sans garanties de gouvernance, l'IA peut introduire des biais, compromettre la sécurité ou opérer en dehors des limites réglementaires.

Établir des lignes directrices éthiques

La gouvernance éthique de l'IA met l'accent sur l'équité, la transparence et la sécurité. Les pratiques suivantes sont essentielles pour établir une base éthique dans le développement et le déploiement de l'IA :

- Les principes et les normes de l' IA éthique permettent de s'assurer que l'IA fonctionne dans des limites acceptables, en évitant les conséquences involontaires.

- L'élaboration d'un code de déontologie formalise l'utilisation responsable de l'IA, en établissant des lignes directrices claires en matière de transparence, de confidentialité des données et de responsabilité.

Créer des structures de responsabilité

Pour que la gouvernance de l'IA soit applicable, les organisations ont besoin de mécanismes qui permettent de suivre la conformité et de prendre des mesures correctives. Les mesures de responsabilisation les plus courantes sont les suivantes

- Les audits d'IA évaluent la performance des modèles, la conformité et les vulnérabilités en matière de sécurité.

- La planification de la réponse aux incidents prépare les organisations à faire face aux défaillances liées à l'IA, aux failles de sécurité et aux manquements en matière de gouvernance.

En intégrant des lignes directrices éthiques et des mesures de responsabilisation dans les cadres de gouvernance, les organisations peuvent gérer les risques liés à l'IA tout en maintenant la confiance et la conformité.

Cadres réglementaires

La conformité aux cadres réglementaires est essentielle, mais de nombreuses organisations ont du mal à suivre l'évolution des politiques. Selon Deloitte, l'incertitude réglementaire est l'un des principaux obstacles à l'adoption de l'IA, et de nombreuses entreprises mettent en place des structures de gouvernance pour faire face aux risques de conformité.

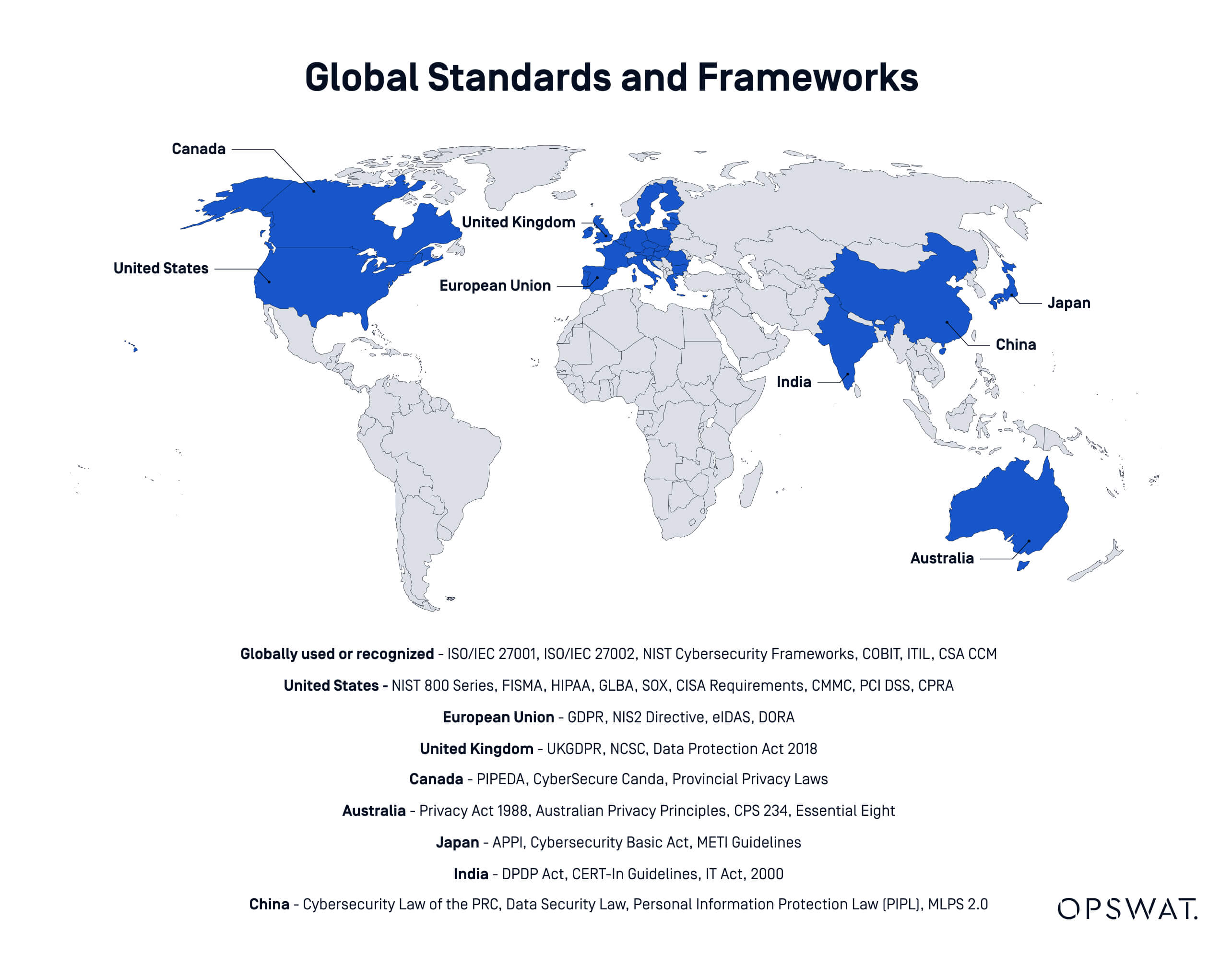

Aperçu des règlements mondiaux

La gouvernance de l'IA est façonnée par des lois spécifiques à chaque région, chacune ayant des exigences de conformité distinctes. Les exemples ci-dessous illustrent la diversité des réglementations dans les principales juridictions :

- La loi européenne sur l'IA établit une surveillance stricte, exigeant la transparence, l'évaluation des risques et la surveillance humaine des applications d'IA à haut risque. Selon l'article 6, les systèmes d'IA sont considérés comme à haut risque s'ils opèrent dans des secteurs d'infrastructures critiques. Les organisations opérant dans l'UE doivent aligner leurs politiques d'IA sur ces lignes directrices.

- Le document SR-11-7 des États-Unis définit les attentes en matière de gestion des risques pour l'IA dans les institutions financières, en mettant l'accent sur la validation des modèles, la gouvernance et les contrôles de sécurité. Des lignes directrices sectorielles similaires sont en train de voir le jour dans tous les secteurs d'activité.

- D'autres politiques internationales, notamment des réglementations au Canada, à Singapour et en Chine, mettent l'accent sur l'utilisation éthique de l'IA, la protection des consommateurs et la responsabilité des entreprises. Les entreprises doivent suivre l'évolution de la réglementation dans les régions où elles déploient l'IA.

En intégrant des lignes directrices éthiques et des mesures de responsabilisation dans les cadres de gouvernance, les organisations peuvent gérer les risques liés à l'IA tout en maintenant la confiance et la conformité.

Stratégies de conformité

Garantir la conformité avec les réglementations en matière d'IA nécessite une approche proactive. Les stratégies suivantes aident les organisations à aligner les cadres de gouvernance sur les exigences légales en constante évolution, en particulier lorsqu'elles travaillent avec des systèmes d'IA à haut risque :

- La mise en place d'une équipe de conformité permet aux organisations de gérer les risques réglementaires, de superviser les audits d'IA et de mettre en œuvre les mesures de gouvernance requises.

- Pour relever les défis réglementaires, il faut suivre en permanence l'évolution des politiques tout en adaptant les structures de gouvernance dans un environnement complexe où les réglementations se chevauchent souvent.

- Les audits et les rapports réglementaires aident les organisations à démontrer leur conformité et à prévenir les risques juridiques grâce à une surveillance proactive.

En intégrant des stratégies de conformité dans les cadres de gouvernance de l'IA, les organisations peuvent atténuer les risques réglementaires tout en s'assurant que l'IA reste éthique et sécurisée.

Transparence et explicabilité

Les organisations font face à une pression croissante pour rendre explicables les décisions basées sur l'IA, en particulier dans les applications à haut risque telles que la finance, les soins de santé et la cybersécurité. Malgré cela, de nombreux modèles d'IA restent complexes, ce qui limite la visibilité sur leur fonctionnement.

Conception de systèmes d'IA transparents

La transparence de l'IA implique de rendre les processus décisionnels compréhensibles pour les parties prenantes, les régulateurs et les utilisateurs finaux. Les approches suivantes favorisent l'explicabilité de l'IA et contribuent à atténuer les risques associés aux modèles d'IA dits "boîte noire" dont le fonctionnement interne n'est pas facilement compréhensible :

- Des stratégies de communication efficaces aident les organisations à traduire les décisions prises en matière d'IA en résultats clairs et interprétables. La fourniture de documentation, de résumés de modèles et d'évaluations d'impact peut améliorer la transparence.

- Les outils et les technologies de transparence garantissent une IA explicable en donnant un aperçu de la manière dont les modèles d'IA traitent les données et génèrent des résultats. Les outils d'audit de l'IA, les cadres d'interprétabilité et les techniques d'IA explicable (XAI) permettent d'atténuer les préoccupations liées à la prise de décision en boîte noire.

En donnant la priorité à la transparence, les organisations peuvent améliorer l'alignement réglementaire, réduire les risques liés aux préjugés et renforcer la confiance dans les applications d'IA.

Suivi et amélioration continue

La gouvernance de l'IA est un processus continu qui nécessite une surveillance, une évaluation des risques et un perfectionnement permanents pour garantir la sécurité et la conformité. Comme les systèmes pilotés par l'IA traitent des volumes croissants de données sensibles, les organisations doivent établir des flux de travail sécurisés pour empêcher les accès non autorisés et les violations de la réglementation.

Les solutions de transfert de fichiers gérées jouent un rôle essentiel dans l'application des politiques d'IA, le maintien de l'auditabilité et la réduction des risques de conformité dans les échanges de données alimentés par l'IA.

Mesures des performances et boucles de rétroaction

Le suivi des performances des systèmes d'IA est essentiel pour garantir la fiabilité, la sécurité et la conformité. Les pratiques suivantes contribuent à un suivi solide et à une gouvernance adaptative :

- Les fluxSecure empêchent tout accès non autorisé et garantissent que les échanges de données basés sur l'IA respectent des politiques de sécurité strictes. MetaDefender Managed File Transfer MFT)™ OPSWATpermet aux entreprises de mettre en œuvre un chiffrement, des contrôles d'accès et une surveillance automatisée de la conformité afin de réduire le risque d'exposition des données.

- Les mécanismes de gouvernanceAdaptive permettent aux modèles d'IA d'affiner la prise de décision sur la base d'un retour d'information continu, tout en maintenant des mesures strictes de sécurité et de conformité. Les solutions de sécurité pilotées par l'IA, telles que les plateformes de Managed File Transfer , aident à classer les données sensibles en temps réel, garantissant le respect des exigences réglementaires en constante évolution.

Construire des cadres de risque pour l'amélioration continue

Les flux de travail alimentés par l'IA doivent être évalués en permanence pour détecter les vulnérabilités, en particulier à mesure que les cybermenaces évoluent. Selon le Forum économique mondial, 72 % des organisations interrogées ont signalé une augmentation des cyberrisques au cours de l'année écoulée, sous l'effet de l'augmentation du phishing, de l'ingénierie sociale, de l'usurpation d'identité et de la fraude cybernétique. Les stratégies suivantes favorisent la résilience à long terme :

- La mise en œuvre de mesures de sécurité basées sur l'IA protège les échanges de données IA en intégrant des contrôles avancés de détection des menaces, de prévention des pertes de donnéeset de conformité. MetaDefender Managed File Transfer MFT)™ garantit aux organisations un transfert sécurisé des données sensibles liées à l'IA sans augmenter leur exposition réglementaire.

- L'application automatisée de la conformité rationalise le respect des réglementations en appliquant des politiques de sécurité prédéfinies à tous les transferts de fichiers liés à l'IA. En s'appuyant sur des solutions de gouvernance alimentées par l'IA, les organisations peuvent réduire le risque de violation des données tout en maintenant l'efficacité opérationnelle.

En intégrant des flux de données sécurisés dans leurs stratégies de gouvernance de l'IA, les organisations peuvent renforcer la sécurité, maintenir la conformité et garantir l'intégrité des processus décisionnels basés sur l'IA. Des solutions telles que MetaDefender Managed File Transfer MFT) fournissent les garanties nécessaires pour prendre en charge des opérations d'IA sécurisées et conformes.

MetaDefender Managed File Transfer MFT) – Solution de sécurité et de conformité basée sur l'IA

MetaDefender Managed File Transfer MFT) joue un rôle crucial dans la gouvernance de la sécurité de l'IA en fournissant :

- Transferts de fichiers soumis à des règles qui appliquent automatiquement des contrôles de sécurité, tels que des restrictions d'accès, des exigences de cryptage et des validations de conformité.

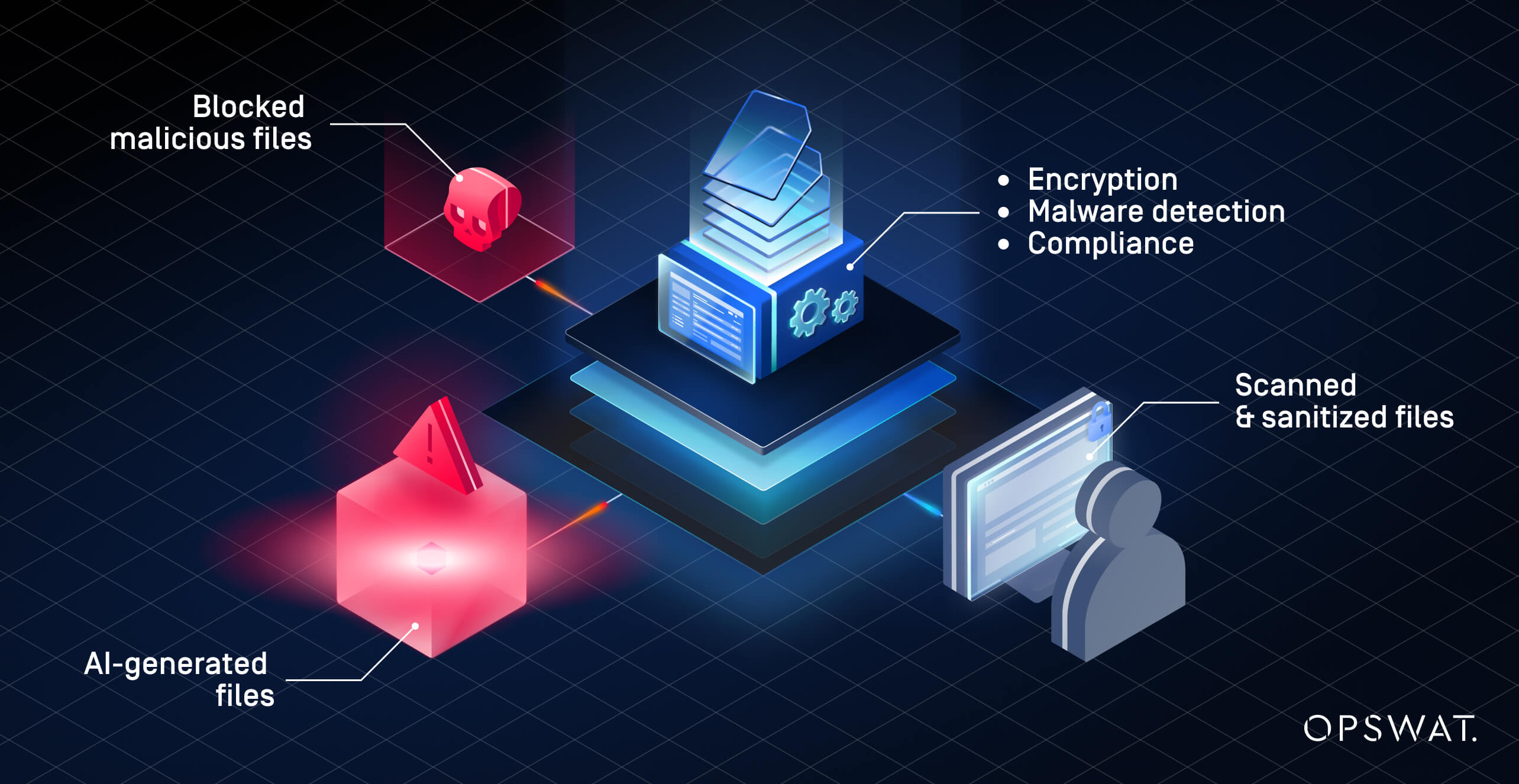

- Prévention avancée des menaces grâce à une détection multicouche qui identifie et bloque les logiciels malveillants, les ransomwares, les scripts intégrés et d'autres menaces basées sur des fichiers couramment utilisés dans les attaques générées par l'IA.

- Mesures de sécurité axées sur la conformité qui prennent en charge les mandats réglementaires, notamment GDPR, PCI DSS et NIS2, en intégrant l'enregistrement des audits, les contrôles d'accès basés sur les rôles et l'application de politiques personnalisables.

- Des flux de donnéesSecure et gérés qui garantissent que les transferts de fichiers pilotés par l'IA sont cryptés (AES-256, TLS 1.3), vérifiés et protégés contre la manipulation ou l'injection de charges utiles malveillantes tout au long du processus d'échange.

- En intégrant Multiscanning des moteurs heuristiques et d'apprentissage automatique, Multiscanning la technologie Deep CDR™ et Multiscanning des technologies de sandboxing basées sur l'IA, MetaDefender Managed File Transfer MFT) protège les données générées par l'IA contre les cybermenaces en constante évolution tout en garantissant le respect des réglementations en matière de gouvernance de l'IA.

Sécuriser les flux de données pilotés par l'IA

Les modèles d'IA reposent sur d'importants volumes de données qui circulent souvent entre plusieurs systèmes, ce qui rend essentiels les transferts de données sécurisés. Sans contrôles appropriés, les données générées et traitées par l'IA peuvent être vulnérables à la falsification, à l'accès non autorisé ou aux violations de la conformité.

MetaDefender Managed File Transfer MFT) garantit la protection des flux de données basés sur l'IA grâce à :

- Cryptage de bout en bout utilisant AES-256 et TLS 1.3, sécurisant les données à la fois en transit et au repos

- Authentification stricte et contrôles d'accès avec intégration d'Active Directory, SSO (single sign-on) et MFA (multi-factor authentication) pour empêcher les échanges de données non autorisés.

- Vérification de l'intégrité des données grâce à la validation de la somme de contrôle, garantissant que les fichiers générés par l'IA ne sont pas altérés lors des transferts.

En appliquant ces mesures de sécurité, les organisations peuvent intégrer en toute sécurité des processus pilotés par l'IA dans leur infrastructure existante sans exposer les données sensibles à des risques.

Prévention des menaces par l'IA

Le contenu généré par l'IA pose de nouveaux défis en matière de sécurité, notamment les attaques adversaires par IA, les logiciels malveillants intégrés et les exploits basés sur des fichiers. MetaDefender Managed File Transfer MFT) renforce la sécurité grâce à plusieurs niveaux de protection, empêchant les cyberattaques basées sur l'IA d'atteindre les systèmes critiques.

La technologie Metascan™ Multiscanning s'appuie sur plus de 30 moteurs anti-malware pour détecter les menaces connues et celles du jour zéro, garantissant que les fichiers générés par l'IA sont exempts de charges utiles malveillantes. Pour en savoir plus sur cette technologie , cliquez ici.

La technologie Deep CDR™ élimine les menaces cachées en supprimant le contenu actif des fichiers tout en préservant leur fonctionnalité, une étape essentielle pour prévenir les exploits générés par l'IA. Pour en savoir plus sur son fonctionnement, cliquez ici.

MetaDefender détecte les logiciels malveillants furtifs en exécutant les fichiers suspects échangés par IA dans un environnement isolé, puis en analysant leur comportement afin de mettre au jour les menaces indétectables par les mesures de sécurité traditionnelles. Découvrez ici ce que les clients pensent de cette technologie.

Ces fonctionnalités font MetaDefender Managed File Transfer MFT) une solution de sécurité complète pour les organisations qui s'appuient sur des échanges de données basés sur l'IA tout en devant prévenir l'infiltration de logiciels malveillants et les violations de conformité.

Gouvernance de l'IA axée sur la conformité

Les données générées par l'IA sont soumises à une surveillance réglementaire stricte, qui oblige les organisations à mettre en œuvre des politiques de sécurité garantissant la conformité avec les cadres juridiques en constante évolution. MetaDefender Managed File Transfer MFT) aide les entreprises à répondre à ces exigences en intégrant des contrôles de conformité proactifs dans chaque transfert de fichiers :

- Proactive DLP™ analyse les fichiers générés par l'IA à la recherche de contenu sensible, empêchant ainsi l'exposition de données non autorisées et garantissant la conformité aux réglementations telles que GDPR, PCI DSS et NIS2.

- Des journaux d'audit complets et des rapports de conformité offrent une visibilité sur les transferts de fichiers liés à l'IA, ce qui permet aux entreprises de suivre les accès, les modifications et l'application des politiques.

- Les contrôles d'accès basés sur les rôles (RBAC) mettent en œuvre des autorisations granulaires, garantissant que seuls les utilisateurs autorisés peuvent accéder ou transférer des fichiers liés à l'IA conformément aux politiques de gouvernance.

Grâce à ces capacités de gouvernance, MetaDefender Managed File Transfer MFT) sécurise non seulement les données d'IA, mais aide également les organisations à se conformer aux exigences réglementaires, réduisant ainsi les risques juridiques et opérationnels associés aux processus basés sur l'IA.

Renforcez la sécurité de l'IA avec MetaDefender Managed File Transfer MFT)

Les flux de données basés sur l'IA nécessitent des contrôles de sécurité et de conformité robustes. MetaDefender Managed File Transfer MFT) fournit des solutions avancées de prévention des menaces, de conformité réglementaire et d'échange sécurisé de données pour les environnements basés sur l'IA. Découvrez comment la solution de transfert de fichiers géréeMFT OPSWAT, leader du secteur,MFT améliorer votre stratégie de gouvernance de l'IA.